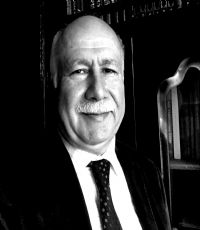

Uzmanından yapay zeka dolandırıcılığı uyarısı: Ses kopyalamaya dikkat!

Günümüzün en çok konuşulan konularından biri olan yapay zeka, hayatımıza yenilik ve kolaylıklar getirse de kötü niyetli kişilerin elinde dolandırıcılık için de kullanılabiliyor. Uzman isimden yapay zekayla ilgili dikkat çeken uyarılar geldi.

Kayseri Üniversitesi (KAYÜ) Siber Güvenlik Uygulama ve Araştırma Merkezi Müdürü Doç. Dr. Ali Gezer, seslerinin yapay zekayla klonlanıp dolandırıcılıkta kullandığını belirterek, vatandaşları dikkatli olmaları konusunda uyardı.

Gezer, yapay zeka kullanarak yeni yöntemler kullanmaya başladığını söyledi.

Gelişen teknolojiyle beraber insan seslerinin gerçeğe en yakın şekilde kopyalanabildiğine dikkati çeken Gezer, "Yapay sinir ağları kullanılarak çok kolay ve hızlı bir şekilde sesin klonlanması gerçekleştirilebiliyor. Burada ilgili kişinin sesinin frekansını, konuşma hızını, konuşmalar arasındaki boşluklarını, tınısını, tonunu ve benzer özelliklerini yapay sinir ağı öğrenmeye başlıyor. Yapay sinir ağı, modeli ortaya çıkarttıktan sonra metin veriliyor. Metni konuşmaya çeviren yapay sinir ağına giriş yapılarak metin ilgili kişinin yapay konuşmasına çevrilmiş oluyor." diye konuştu.

Gezer, ses klonlamada birçok tekniğin kullanıldığını ve dolandırıcıların hedefteki kişinin ses örneklerini alması gerektiğini dile getirerek, şöyle devam etti:

"SES ÖRNEĞİ İÇİN FARKLI TEKNİKLER"

"Ses örneği almak için farklı teknikler uygulayabilirler. İlgili kişileri telefon açıkken konuşturup veya sosyal medya hesaplarındaki videolardan ses örnekleri elde edilebilir. Bu örnekler yeteri kadar olduğu takdirde model öğrenmeye başlayacaktır. Burada yapay sinir ağı modelleri eğitiliyor ve kişinin sesini öğrenmiş oluyor. Kişi böyle bir şeyden şüphelendiğinde karşı taraftan görüntülü aramasını talep edebilir veya konuşmadan sonra kendisi ilgili kişiyi arayıp böyle bir arama yapıp yapmadığını öğrenebilir. Eğer sosyal medya platformları herkese açıksa bu saldırıya maruz kalma ihtimali herkes için çok yüksektir. Sosyal medya platformlarımızı sadece ilgili kişilere ve arkadaşlarımıza açmak, herkese açık hale getirmemek yapılacak akıllıca bir iştir. Burada sosyal medya platformlarını iki faktörlü doğrulama gibi yöntemlerle doğrulamak ve girişi o şekilde yapmak faydamıza olacaktır."

"ÜRÜN TANITIMI İÇİN KULLANILABİLİR"

Gezer, saldırganın gerçekçi bir senaryo hazırlayarak en uygun sesle hedefteki kişiyi kolayca kandırabildiğini ifade etti.

Farklı yöntemlerle insanların etki altına alınabildiğini vurgulayan Gezer, şunları kaydetti:

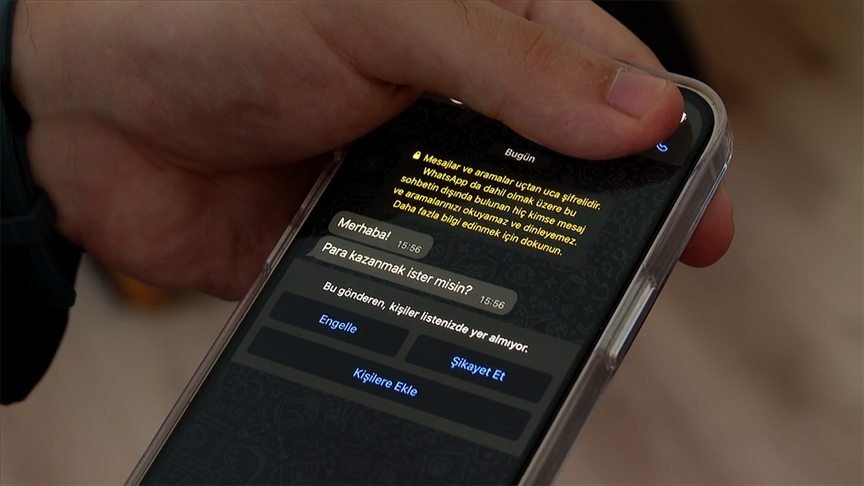

"Saldırgan, kişinin yakınlarını arayıp sesini taklit ederek, 'kaçırıldım' veya 'kaza yaptım' deyip acil para isteyebilir. Hedefteki kişi, yine hedefteki bir kurumda çalışıyorsa, bu kurum saldırganın amacına yönelik olarak 'kasayı açın, denilenleri yapın, belgeyi teslim edin, belgeyi şu mail adresine gönderin, para transferi yapın' şeklinde bir soygun ortamı hazırlanabilir. Tanınmış ünlü ses sanatçılarının sesleri kullanılarak bir eser ortaya çıkarılıp sunulabilir. Yine bir ses sanatçısının sesi kullanılarak ürün tanıtımı yapılabilir. Saldırgan için sonsuz varyasyonlu bir opsiyon."

Görüşmede sesin saldırgana kapatılması gerektiğini dile getiren Gezer, "Tanımadığımız numaralardan bir arama yapıldığında açmamak doğru olacaktır. Bilinmeyen numara aradığı zaman karşı taraftan uzun bir süre ses gelmiyorsa sesi alıp kopyalıyor olabilirler. Öyle bir durumda hemen kapatmak çok yerinde olacaktır çünkü karşı tarafın alacağı ses örneği ne kadar uzun olursa o kadar başarılı yapay ses üretimi gerçekleştirecektir." ifadelerini kullandı.

|

Yorumcuların dikkatine… • İmlası çok bozuk, • Büyük harfle yazılan, • Habere değil yorumculara yönelik, • Diğer kişilere hakaret niteliği taşıyan, • Argo, küfür ve ırkçı ifadeler içeren, • Bir iki kelimelik, konuyu zenginleştirmeyen, yorumlar KESİNLİKLE YAYIMLANMAYACAKTIR. |

Bu haber henüz yorumlanmamış...

Bunlar da ilginizi çekebilir...